2. 西南大学 外国语学院,重庆 400715;

3. 重庆长鹏实业(集团)有限公司,重庆 401325

2. College of International Studies, Southwest University, Chongqing 400715, P. R. China;

3. Chongqing Changpeng Industrial Group Co., Ltd., Chongqing 401325, P. R. China

人脸识别作为一种重要的生物特征识别方法具有独特的优势和广阔的应用前景,受到了学术界的广泛重视,已成为计算机视觉领域最受关注的研究课题之一。目前,主流的人脸识别方法仍然立足于图像的灰度信息,但有研究表明,色彩信息对提高识别性能也有重要意义[1-2],近年来逐渐提出了一些彩色人脸识别方法。

目前的彩色人脸识别方法主要有两大类。第一类方法可以认为是传统基于灰度图像方法的扩展,这类方法首先寻找适合表征人脸信息的色彩空间,然后在新的色彩空间中对图像的各个分量提取特征,而特征提取方法基本仍是沿用处理灰度图像的方法,如局部二元模式、Gabor小波变换、离散余弦变换等[3-6]。第二类方法主要考虑消除彩色图像多个分量之间的相关性,从而最大限度的利用图像的多个分量提供的信息[7-10]。

在特定条件下,这些方法利用色彩信息能够提高识别精度。然而,它们几乎都忽略了一个在实际应用中无法避免的重要问题,即光照对图像色彩的影响。数码相机拍摄的图像与光照的关系可描述为以下公式[11]

| $ \begin{array}{l} {I_c}\left( x \right) = {w_d}\left( x \right)\int {_\mathit{\Omega }{S_d}\left( {\lambda, x} \right)E\left( \lambda \right){q_c}\left( \lambda \right){\rm{d}}} \lambda + \\ \;\;\;\;\;\;\;\;\;\;\;{{\tilde w}_s}\left( x \right)\int {_\mathit{\Omega }E\left( \lambda \right){q_c}\left( \lambda \right){\rm{d}}\lambda } \end{array} $ | (1) |

其中:Ic表示RGB彩色图像的c分量; c={R, G, B}; x为空间位置坐标; wd(x)和

一个可靠的彩色人脸识别系统,必须消除光照对色彩信息的影响。在计算机视觉中,确定入射光源的颜色并消除其对图像色彩的影响称为色彩恒常性(color constancy)。虽然色彩恒常性已有大量研究[11, 13-16],但目前还几乎没有在人脸识别中的应用。从文献[11]的光强倒数色度空间(inverse-intensity chromaticity space,IICS)色彩恒常性理论出发,笔者提出一种用于人脸识别的分块IICS的光照预处理方法,将图像光照校正为标准白光,消除光照对图像色彩的影响,并将校正后的图像用于人脸识别。本方法首先将图像均匀的分成子块;然后将每个图像块转换为IICS空间中的二维数据集合,并利用数据集在IICS空间中的线性分布特性估计图像块的光照颜色;再将所有图像块的光照估计进行颜色直方图统计,对分块估计的结果进行合并,得到光照估计的最终结果;最后利用对角模型将图像光照校正到标准白光下。AR和FERET人脸库上的实验表明该预处理方法能有效提高彩色人脸识别方法在光照变化条件下的识别率。同时,展示了光照预处理是改善彩色人脸识别性能的一种有效途径。

1 基于分块IICS的光照预处理 1.1 光强倒数色度空间(IICS)IICS基于式(1)的成像模型,认为:1)空间某一点的光强是物体在该点处的漫反射和镜面反射的线性组合;2)镜面反射光的颜色近似于入射光的颜色[11],可以通过确定镜面反射光的颜色来确定入射光的颜色;3)彩色图像的R、G、B 3通道的信息相互独立,估计光照颜色时可对3个通道分别估计。通过一系列转换,式(1)可以写重写为以下形式:

| $ {I_c}\left( x \right) = {m_d}\left( x \right){\mathit{\Lambda }_c}\left( x \right) + {m_s}\left( x \right){\mathit{\Gamma }_c}, $ | (2) |

其中:md(x)和ms(x)分别是包含了光源与反射面几何关系的漫反射和镜面反射参数; Λc(x)和Γc分别为

| $ {\mathit{\Lambda }_c}\left( x \right) = \frac{{{B_c}\left( x \right)}}{{\sum {_i{B_i}\left( x \right)} }}\;\;\;\;i \in \left\{ {R, G, B} \right\}, $ | (3) |

| $ {\mathit{\Gamma }_c} = \frac{G}{{\sum {_i{G_i}} }}\;\;\;i \in \left\{ {R, G, B} \right\}, $ | (4) |

Λc(x)和Γc分别被称为漫反射色度和镜面反射色度,在物理意义上分别表示只有漫反射和只有镜面反射时,反射光的颜色。Bc(x)和Gc分别对应于式(1)中关于漫反射和镜面反射的2个积分项

| $ {B_c}\left( x \right) = \int {_\mathit{\Omega }{S_d}\left( {\lambda, x} \right)E\left( \lambda \right){q_c}\left( \lambda \right){\rm{d}}} \lambda, $ | (5) |

| $ {G_c} = \int {_\mathit{\Omega }E\left( \lambda \right){q_c}\left( \lambda \right){\rm{d}}\lambda {\rm{, }}} $ | (6) |

令σc(x)=Ic(x)/∑iIi(x),对式(2)进一步推导可得

| $ {\sigma _c}\left( x \right) = \left\{ \begin{array}{l} {p_c}\left( x \right)\frac{1}{{\sum {_i{I_i}\left( x \right)} }} + {\mathit{\Gamma }_c}\;\;\;\;\;{m_s}\left( x \right) \ne 0时, \\ {\mathit{\Lambda }_c}\left( x \right)\;\;\;\;\;{m_s}\left( x \right) = 0时; \end{array} \right. $ | (7) |

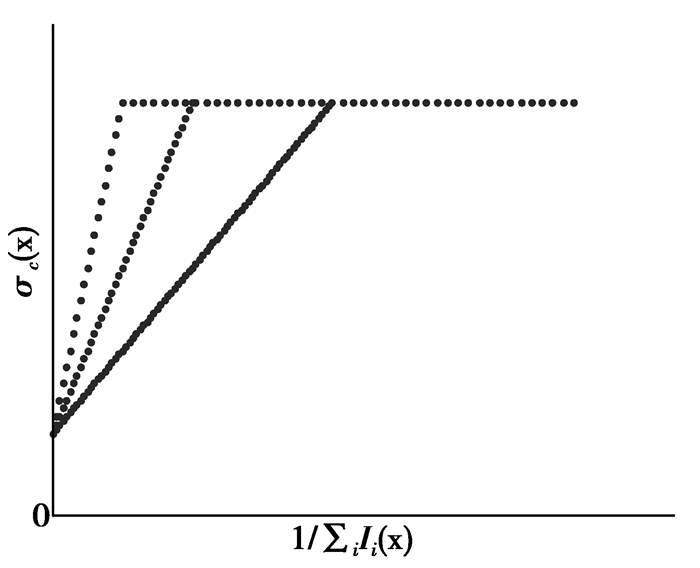

其中pc(x)=md(x)(Λc(x)-Γc)。如果把

|

图 1 像素在IICS空间中的分布示意图 Figure 1 Pixel distribution in the IICS |

由于镜面反射光的颜色近似于入射光的颜色,计算式(7)中的Γc即可得到入射光的颜色。由于一幅实际的图像成像时可能存在多光源的问题,因此不同的图像区域对应的Γc应该不同,文献[14]提出了首先利用图像分割算法对图像进行分割,然后在每个分割出的子区域中分别计算Γc。文献[14]的方法针对的是自然图像,图像场景较大,光照分布可能很复杂,而人脸图像只包含面部区域,光照分布相对比较简单,因此不使用复杂的图像分割算法,而将图像均匀的分块处理。

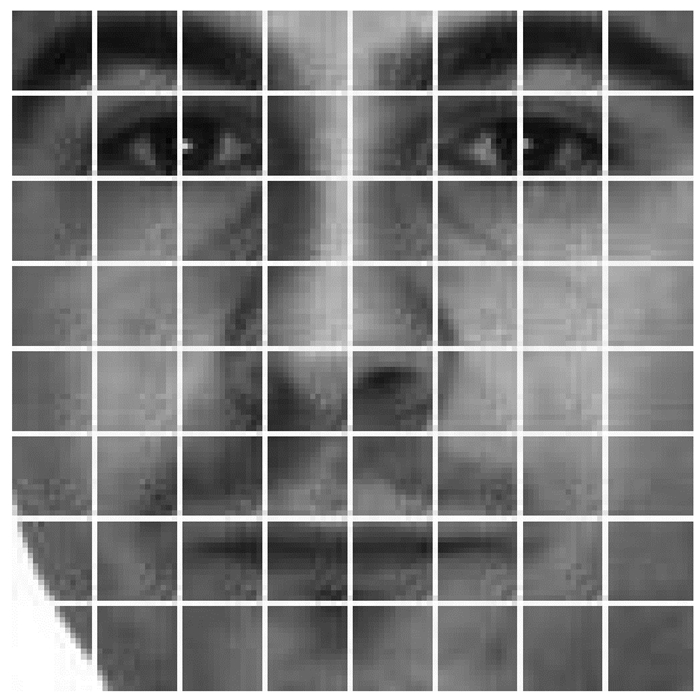

笔者将人脸图像均匀的划分为多个矩形块(如图 2所示),在每个图像块上分别计算Γc,最后综合每个图像块的Γc得到整幅图像的光照估计。对于每个图像块,由于面积较小,认为只有一个光源照射到该区域,因此有唯一的Γc。计算Γc时,实际上只能利用式(7)中ms(x)≠0的部分(即只能利用图 1中的斜线,需要排除水平线);同时为了得到较准确的Γc值,数据点需要有一个较狭长的分布(即图 1中斜线上的点应比较分散)。为了满足这2个要求,采用以下步骤计算式(7)中的pc(x)

|

图 2 图像块划分示意图 Figure 2 Division of the image |

1)计算图像块内每个像素点对应的(

2)对数据集A进行主成分分析,得到其2个特征值λ1和λ2(λ1>λ2),以及相应的特征向量v1和v2;

3)计算向量v1的斜率;

4)计算离心率

v1的斜率即为pc(x),同时要求pc(x)>Tp(排除图 1中的水平线),且e>Te(保证数据点有一个较狭长的分布)。若该图像块计算出的pc(x)不满足要求,则认为该图像块提供的数据不能用于光照估计,不再计算Γc;若pc(x)满足要求,将pc(x)和图像块内每个点的(

由于光照的连续性,通常相邻区块的光照相近,因此得到全部图像块的光照估计Γc, i(i=1…N,N为有效估计出光照的图像块数量)后,对其进行颜色直方图统计,找到直方图的各局部极值,然后将落入该极值区域内的Γc, i计算平均值,作为相应图像块最终的光照估计。对于不满足条件,无法计算Γc的图像块,取其邻域图像块光照的均值,作为该块的光照估计。

估计出光照之后,估计光照归一化为单位向量

| $ \left( {\begin{array}{*{20}{c}} {{I_{R, s}}}\\ {{I_{G, s}}}\\ {{I_{B, s}}} \end{array}} \right) = {\rm{diag}}\left( {\frac{1}{{{{\mathit{\boldsymbol{ \boldsymbol{\hat \varGamma} }}}_R}\sqrt 3 }}, \frac{1}{{{{\mathit{\boldsymbol{ \boldsymbol{\hat \varGamma} }}}_G}\sqrt 3 }}, \frac{1}{{{{\mathit{\boldsymbol{ \boldsymbol{\hat \varGamma} }}}_B}\sqrt 3 }}} \right) \cdot \left( {\begin{array}{*{20}{c}} {{I_{R, u}}}\\ {{I_{G, u}}}\\ {{I_{B, u}}} \end{array}} \right), $ | (8) |

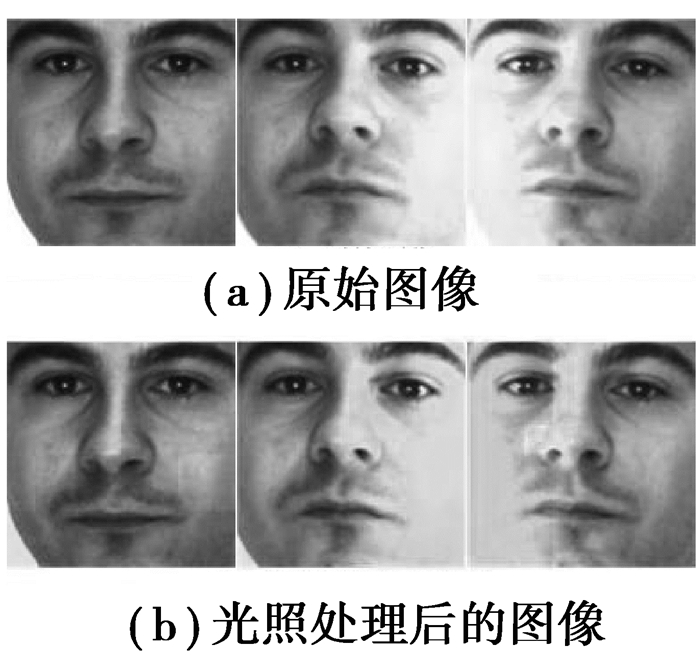

其中IR, s、IG, s、IB, s为标准白光下图像的RGB分量,IR, u、IG, u、IB, u为原始图像的RGB分量。图 3展示了经过光照预处理后的几幅人脸图像。

|

图 3 光照预处理示例图像 Figure 3 Examples of illumination processed images |

为了验证所提出的光照预处理方法的有效性,在AR人脸库和彩色FERET人脸库上进行了人脸识别实验。

对于AR库(如图 4所示),选取每个人的1、5、6、7号图像用于实验,这4幅图像具有不同的光照变化(自然光照、左侧光照、右侧光照、正面光照),因此,该图像集共476幅图像(119人×4幅/人)。图像裁减为128×128像素。实验中,把图像集随机分为2部分,第1部分59人,第2部分为其余的60人。第1部分的全部图像构成训练集(training set),第2部分每人的1号图像构成参考集(gallery set),其余图像构成测试集(probe set)。

|

图 4 AR库中的部分人脸图像 Figure 4 Image Samples in the AR face database |

对于FERET库(如图 5所示),选取其中226人的1107幅图像构成实验图像集,其中每人至少有4幅图像。图像被裁减为128×128像素。实验中,对每人随机选取2幅图像构成参考集,其余图像构成测试集,参考集同时也用作训练集。

|

图 5 彩色FERET库中的部分人脸图像 Figure 5 Image samples in the color FERET face database |

研究选择了4种现有的彩色人脸识别方法[3, 5, 6, 10],通过实验对比原有方法和加入光照预处理之后的识别率。实验中,本文的光照预处理方法参数设置为,图像分块的大小为16×16像素,Tp=0.005,Te=0.95。

AR和FERET人脸库上的识别率分别如表 1和表 2所示。从实验结果可见,加入光照预处理后,4种彩色人脸识别方法的识别率都有提高,并且在AR库上提高十分显著。

| 表 1 AR人脸库上的识别率(%) Table 1 Recognition rates on the AR face database (%) |

| 表 2 FERET人脸库上的识别率(%) Table 2 Recognition rates on the FERET face database (%) |

从AR库上的实验结果可以看到,光照变化对彩色人脸识别方法的影响是非常大的,甚至会使某些识别方法完全失效,如文献[6]的方法识别甚至不到30%。AR库中的图像光照变化比较复杂,其单侧光照的照明方式可视为图像不同区域的入射光源不同,不同区域会呈现出较大的色彩差异,从而严重影响识别性能。由于没有考虑光照的引起的色彩变化,此4种彩色人脸识别方法的效果都不理想。而加入光照预处理,对图像色彩进行校正后,4种方法的识别性能都有大幅改善,识别率至少提高了6.62%。对于文献[6]方法,由于其自身的限制,从识别率的绝对数值来看,加入光照预处理之后也不尽理想,但对识别率的提升仍是显著的。此结果也提示,在设计彩色人识别方法时,方法本身需尽可能考虑到光照问题。

对于FERET库,虽然不同图像之间也存在光照差异,但每幅图像都处于均匀光照下,因此,光照引起的同一幅图像的不同区域之间的色彩变化很小,对识别性能的影响也较小,可以看到,4种彩色人脸识别方法本身也能取得较好效果,但加入光照预处理后识别率有进一步提高,这也验证了研究方法的有效性。

3 结语针对现有彩色人脸识别方法易受光照变化影响的问题,提出了一种基于IICS的彩色人脸图像光照预处理方法。本方法首先将图像均匀分块;然后将每个图像块转换为IICS空间中的二维数据集合,由此估计图像块的光照颜色;再将所有图像块的光照颜色进行颜色直方图统计,对分块估计的结果进行合并,得到光照估计的最终结果;最后将图像转换到标准白光光照下。实验表明本光照预处理方法能有效提高彩色人脸识别方法对光照的鲁棒性。为解决彩色人脸识别中的光照问题提供了一种解决思路。

| [1] | Sinha P, Balas B, Ostrovsky Y, et al. Face recognition by humans: nineteen results all computer vision researchers should know about[J]. Proceedings of the IEEE, 2006, 94(11): 1948–1962. DOI:10.1109/JPROC.2006.884093 |

| [2] | Torres L, Reutter J Y, Lorente L. The importance of the color information in face recognition [C]//Proceedings of 1999 IEEE International Conference on Image Processing, Oct. 24-28, 1999, Kobe: IEEE, 1999: 627-631. http://dblp.uni-trier.de/db/conf/icip/icip1999-3 |

| [3] | Deng W, Hu J, Guo J, et al. Emulating biological strategies for uncontrolled face recognition[J]. Pattern Recognition, 2010, 43(6): 2210–2223. DOI:10.1016/j.patcog.2009.12.026 |

| [4] | Choi J H, Ro Y M, Plataniotis K N. Color face recognition for degraded face images[J]. IEEE Transactions on Systems, Man, and Cybernetics, Part B: Cybernetics, 2009, 39(5): 1217–1230. DOI:10.1109/TSMCB.2009.2014245 |

| [5] | Liu Z, Yang J, Liu C. Extracting multiple features in the CID color space for face recognition[J]. IEEE Transactions on Image Processing, 2010, 19(9): 2502–2509. DOI:10.1109/TIP.2010.2048963 |

| [6] | Liu Z, Liu C. Fusion of the complementary discrete cosine features in the YIQ color space for face recognition[J]. Computer Vision and Image Understanding, 2008, 111(3): 249–262. DOI:10.1016/j.cviu.2007.12.002 |

| [7] | Sun Y, Jia H, Hu Y, et al. Color face recognition based on color image correlation similarity discriminant model[J]. Multimedia Tools and Applications, 2014, 73(3): 2063–2079. DOI:10.1007/s11042-013-1638-y |

| [8] |

郎方年, 周激流, 闫斌, 等.

四元数矩阵正交特征向量系的求解方法及其在彩色人脸识别中的应用[J]. 自动化学报, 2008, 34(2): 121–129.

LANG Fangnian, ZHOU Jiliu, YAN Bin, et al. Obtain method of quaternion matrix orthogonal eigenvector set and its application in color face recognition[J]. Acta Automatica Sinica, 2008, 34(2): 121–129. (in Chinese) |

| [9] | Yang J, Liu C. Color image discriminant models and algorithms for face recognition[J]. IEEE Transactions on Neural Networks, 2008, 19(12): 2088–2098. DOI:10.1109/TNN.2008.2003187 |

| [10] | Liu Z, Liu C. A hybrid color and frequency features method for face recognition[J]. IEEE Transactions on Image Processing, 2008, 17(10): 1975–1980. DOI:10.1109/TIP.2008.2002837 |

| [11] | Tan R, Nishino K, Ikeuchi K. Color constancy through inverse-intensity chromaticity space[J]. Journal of the Optical Society of America A, 2004, 21(3): 321–334. DOI:10.1364/JOSAA.21.000321 |

| [12] |

杜兴, 龚卫国, 仲建华.

模拟生物视觉机制的彩色人脸识别方法[J]. 仪器仪表学报, 2012, 33(8): 1688–1696.

DU Xing, GONG Weiguo, ZHONG Jianhua. Color face recognition method inspired by biological visual mechanisms[J]. Chinese Journal of Scientific Instrument, 2012, 33(8): 1688–1696. (in Chinese) |

| [13] | Gijsenij A, Gevers T, Van De Weijer J. Computational color constancy: survey and experiments[J]. IEEE Transactions on Image Processing, 2011, 20(9): 2475–2489. DOI:10.1109/TIP.2011.2118224 |

| [14] | Riess C, Eibenberger E, Angelopoulou E. Illuminant color estimation for real-world mixed-illuminant scenes [C]//Proceedings of 2011 IEEE International Conference on Computer Vision Workshops, Nov. 6-13, 2011, Barcelona IEEE, 2011(11): 782-789. |

| [15] | Hamid J, Mark D. Exemplar-based color constancy and multiple illumination[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2014, 36(5): 860–873. DOI:10.1109/TPAMI.2013.169 |

| [16] | Van De Weijer J, Gevers T, Gijsenij A. Edge-based color constancy[J]. IEEE Transactions on Image Processing, 2007, 16(9): 2207–2214. DOI:10.1109/TIP.2007.901808 |

2015, Vol. 38

2015, Vol. 38